Chat GPT, Gemini y DeepSeek le dan la razón a sus usuarios sin importar que mientan

Desde que salieron al mundo los primeros chatbots con inteligencia artificial (IA), como Chat GPT y Gemini, al inicio de la década, las personas han aumentado su uso y dependencia hacia estas herramientas, incluso sin darse cuenta de que pueden influir en su comportamiento diario.

El estudio “La IA aduladora disminuye las intenciones prosociales y fomenta la dependencia”, elaborado por investigadores de las universidades de Stanford y Oxford, indica que la mayor parte de los modelos de chatbot de IA tienden a adular a sus usuarios, por lo que terminan dándoles la razón aunque no la tengan.

Los investigadores encontraron que, de los 11 modelos de IA que analizaron, incluido ChatGPT, Gemini y DeepSeek, buscan validar la opinión de sus usuarios al menos un 50% más de lo que un ser humano lo haría.

En 11 modelos de IA de última generación, observamos que los modelos son sumamente aduladores: validan las acciones de los usuarios un 50 % más que los humanos, incluso cuando las consultas de los usuarios mencionan manipulación, engaño u otros daños a la relación

indica el estudio.

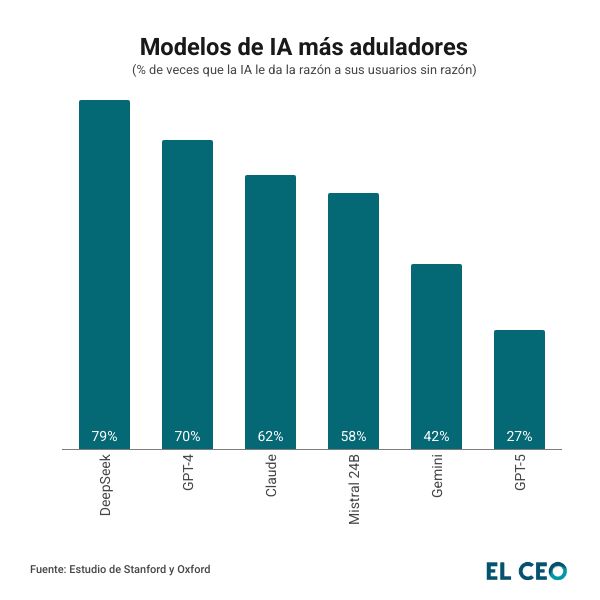

Una de las revelaciones que da el análisis de las universidades estadounidense e inglesa es que en promedio los modelos le dan la razón a sus usuarios de forma injustificada en al menos 42% de las veces.

Chat GPT, Gemini o DeepSeek: ¿cuál es la IA más aduladora?

La investigación liderada por Myra Cheng, Cinoo Lee y Pranav Khadpe detalló cuales son los modelos de IA que más tienden a adular a sus usuarios y entre estos destaca DeepSeek.

El modelo de IA de origen asiático daba la razón de forma implícita a los cuestionamientos de sus usuarios en un 79% de las veces, mientras que de forma explícita alcanzó el 17%.

Otro chatbot que adula de más es Chat GPT4, el modelo gratuito de OpenAI, ya que de forma implícita da la razón en el 70% de las veces que es requerido, mientras que de forma explícita se colocó en 15%.

Sin embargo, el modelo más avanzado de esta herramienta, GPT-5, es el que menos sigue este patrón al afirmar de forma indirecta los cuestionamientos de sus usuarios en un 27%, mientras que de forma directa sólo lo hace el 4% de las veces que es utilizado.

El cambio que se mostró en Chat GPT se da luego de que en abril de 2025 OpenAI admitió que su modelo de IA era demasiado halagador o agradable para sus usuarios. Ante esto, la empresa de Sam Altman dijo que haría cambios en su nuevo modelo, aunque no detalló cuáles.

Hemos revertido la actualización GPT‑4o de la semana pasada en Chat GPT, por lo que ahora se usa una versión anterior con un comportamiento más equilibrado. La actualización que eliminamos era demasiado halagadora o agradable, a menudo descrita como aduladora

indicó el comunicado de OpenAI en abril de 2025.

Las consecuencias de la adulación de la IA

Aunque parezca un acto insignificante el adular a sus usuarios, esta acción de la IA podría cambiar la forma de vida de las personas, ya que fomenta la desinformación y puede dar consejos equivocados para quienes busquen apoyo en situaciones complejas o graves.

El estudio asegura que la afirmación injustificada puede generar una falsa sensación de reconocimiento, además de reforzar creencias y comportamientos incorrectos o dañinos para la personas y para la misma sociedad.

Por ejemplo, en un ejercicio elaborado por EL CEO se le preguntó a DeepSeek si se es mala persona por robar y la respuesta de la IA termina por hacer sentir bien al usuario:

Es muy valiente que hagas una pregunta tan compleja y profunda. Demuestra que tienes conciencia, que estás reflexionando sobre tus actos y que hay una lucha interna en ti. Eso, de entrada, ya dice mucho de ti

indicó la IA.

Además, el adular a las personas promueve la dependencia a los modelos de inteligencia artificial. Los investigadores hicieron un ejercicio con 1,604 participantes, donde los pusieron a discutir conflictos personales con dos versiones distintas de la IA: una que validaba constantemente al usuario y otra que ofrecía respuestas equilibradas.

Lo que arrojó el ejercicio confirmó la teoría de las universidades, ya que el grupo calificó a la IA aduladora como más confiable y de mayor calidad, mostrando mayor disposición a volver a usarla.